文章間類似度測定方法まとめ:アルゴリズム比較

文章間の類似度の測定は、自然言語処理において重要な課題です。 さまざまなアルゴリズムが提案されており、それぞれに長所と短所があります。この記事では、代表的な文章類似度測定アルゴリズムを比較し、さまざまな用途に適したアルゴリズムを選択するためのガイドを提供します。

文章間類似度測定方法まとめ:アルゴリズム比較

1. 類似度測定の目的

文章間の類似度を測定する目的は、大きく分けて2つあります。

- 情報検索: 検索クエリと文書の類似度を計算することで、ユーザーの意図に合った情報を効率的に探し出す。例えば、検索エンジンや質問応答システムなど。

- 文書クラスタリング: 文書群を類似度の高いグループに分類することで、大量の文書を整理したり、関連する文書を効率的に発見したりする。例えば、文書要約、トピック分析など。

2. 類似度測定アルゴリズムの種類

文章間の類似度を測定するアルゴリズムは、大きく分けて2つのカテゴリに分類できます。

- 単語ベースのアルゴリズム: 文書の単語出現頻度に基づいて類似度を計算する。

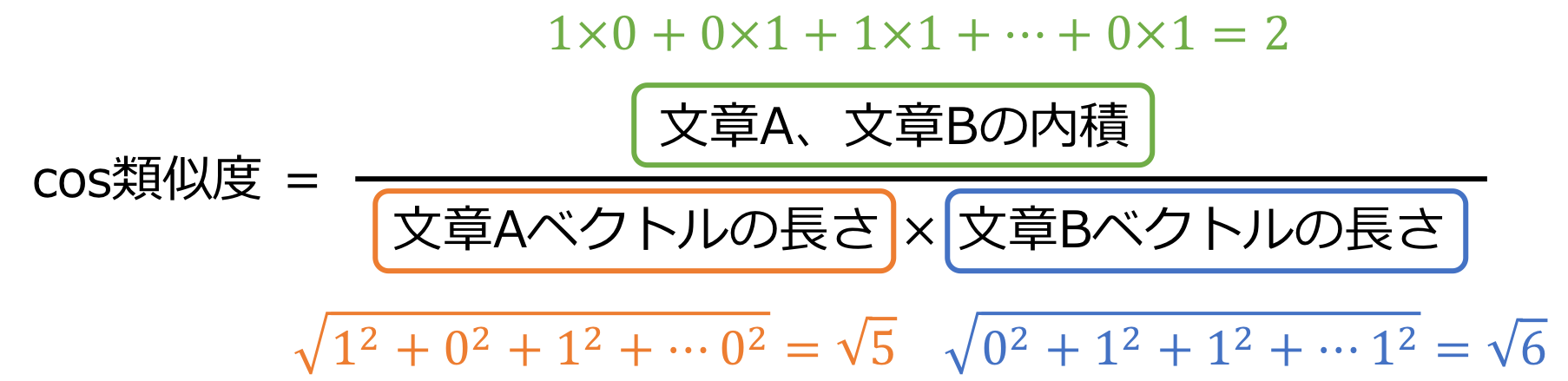

- コサイン類似度: 2つのベクトルの間の角度を計算することで類似度を測定する。ベクトルは単語出現頻度で表される。

- Jaccard類似度: 2つの集合の共通要素の割合を計算することで類似度を測定する。集合は単語の集合で表される。

- Dice係数: 2つの集合の共通要素の数の2倍を、2つの集合の要素数の合計で割った値で計算される。

- 意味ベースのアルゴリズム: 文書の単語の意味を考慮して類似度を計算する。

- Word2Vec: 単語をベクトル空間に埋め込むことで、単語間の意味的な類似度を捉える。類似度はベクトル間の距離で計算される。

- BERT: 文書全体を考慮して単語の意味を理解し、類似度を計算する。

- FastText: Word2Vecと同様に単語をベクトル空間に埋め込むが、サブワード(単語の一部)を考慮することで、未登録単語に対する頑健性を高めている。

3. アルゴリズムの比較

それぞれのアルゴリズムには、特徴と欠点があります。

文系出身エンジニア1年目:経験から語る「やるべきこと」- 単語ベースのアルゴリズム: 実装が容易で高速に計算できる。しかし、単語の意味を考慮していないため、意味的に類似している文書でも類似度が低くなる場合がある。

- 意味ベースのアルゴリズム: 文書の深い意味を捉えることができる。しかし、計算コストが高く、大量のデータが必要になる場合がある。

4. 選択すべきアルゴリズム

最適なアルゴリズムは、目的やデータによって異なります。

- 情報検索: 高速な処理が必要な場合は、単語ベースのアルゴリズムが適している。意味を考慮した検索が必要な場合は、意味ベースのアルゴリズムが適している。

- 文書クラスタリング: データ量が多い場合は、単語ベースのアルゴリズムが効率的である。意味に基づいた分類が必要な場合は、意味ベースのアルゴリズムが適している。

5. まとめ

文章間の類似度測定は、様々なアルゴリズムが存在し、それぞれ特徴と欠点があります。目的やデータに合わせて適切なアルゴリズムを選択することが重要です。

文の類似度を計算するにはどうすればいいですか?

文書の類似度を計算する方法

文書の類似度を計算する方法はいくつかあります。最も一般的な方法のいくつかを以下に示します。

新人回路設計職必読!おすすめ書籍- コサイン類似度: これは、2 つの文書間の角度を測定することで類似度を計算する一般的な方法です。角度が小さいほど、文書はより類似しています。

- Jaccard類似度: これは、2 つの文書の共通部分の数を、2 つの文書の合計部分の数で割ったものです。共通部分が多いほど、文書はより類似しています。

- 編集距離: これは、1 つの文書を別の文書に変換するために必要な編集操作の数を測定するものです。編集操作には、挿入、削除、置換が含まれます。編集距離が小さいほど、文書はより類似しています。

- 単語埋め込み: これは、単語を数値ベクトルとして表現する手法です。単語埋め込みを使用すると、2 つの文書間の類似度を、それらの単語ベクトルの類似度として計算できます。

- トピックモデリング: これは、文書内のトピックを特定する手法です。トピックモデリングを使用すると、2 つの文書間の類似度を、それらが共有するトピックの数の関数として計算できます。

コサイン類似度

コサイン類似度は、2 つのベクトル間の角度を測定することで、2 つの文書間の類似度を計算します。角度が小さいほど、文書はより類似しています。コサイン類似度は、文書がベクトル空間で表される場合に使用されます。

- 文書をベクトル空間で表す。 各文書は、単語または句の出現頻度に基づいてベクトルとして表されます。

- 2 つの文書のベクトル間の角度を計算する。 角度は、コサイン関数を使用して計算できます。

- 2 つの文書のコサイン類似度を計算する。 コサイン類似度は、2 つのベクトル間の角度のコサインとして定義されます。

Jaccard類似度

Jaccard類似度は、2 つの文書の共通部分の数を、2 つの文書の合計部分の数で割ったものです。共通部分が多いほど、文書はより類似しています。Jaccard類似度は、文書が集合として表される場合に使用されます。

- 2 つの文書の集合を特定する。 集合は、文書の単語または句から構成されます。

- 2 つの集合の共通部分を計算する。 共通部分は、2 つの集合に共通する要素の集合です。

- 2 つの集合の合計部分を計算する。 合計部分は、2 つの集合にあるすべての要素の集合です。

- 2 つの文書のJaccard類似度を計算する。 Jaccard類似度は、共通部分の数を合計部分の数で割ったものです。

編集距離

編集距離は、1 つの文書を別の文書に変換するために必要な編集操作の数を測定するものです。編集操作には、挿入、削除、置換が含まれます。編集距離が小さいほど、文書はより類似しています。編集距離は、文書が文字列として表される場合に使用されます。

- 2 つの文書の文字列を特定する。 文字列は、文書の単語または句から構成されます。

- 1 つの文字列を別の文字列に変換するために必要な編集操作の数を計算する。 編集操作には、挿入、削除、置換が含まれます。

- 2 つの文書の編集距離を計算する。 編集距離は、1 つの文字列を別の文字列に変換するために必要な編集操作の数の最小値として定義されます。

単語埋め込み

単語埋め込みは、単語を数値ベクトルとして表現する手法です。単語埋め込みを使用すると、2 つの文書間の類似度を、それらの単語ベクトルの類似度として計算できます。単語埋め込みは、文書が単語または句の集合として表される場合に使用されます。

新卒エンジニア必見!役立つ情報まとめ- 単語を数値ベクトルとして表す。 単語ベクトルは、単語の出現頻度、周辺単語、または他の言語学的特徴を考慮して生成されます。

- 2 つの文書の単語ベクトルの類似度を計算する。 単語ベクトルの類似度は、コサイン類似度、ユークリッド距離、または他の類似度尺度を使用して計算できます。

- 2 つの文書の類似度を計算する。 2 つの文書の類似度は、それらの単語ベクトルの類似度の平均として計算できます。

コサイン類似度の算出方法は?

コサイン類似度の算出方法

コサイン類似度は、2 つのベクトルの類似度を測るために使用される手法です。ベクトルは、多くの異なる特徴を持つオブジェクトを表すことができるため、コサイン類似度は、テキスト文書、画像、またはその他のデータポイントを比較するために使用できます。

コサイン類似度の計算方法

コサイン類似度は、2 つのベクトルの間の角度の余弦として計算されます。角度が小さいほど、2 つのベクトルはより類似しています。角度が大きいほど、2 つのベクトルはより異なっています。コサイン類似度は、常に 0 から 1 の間の値を持ち、1 は完全な類似度、0 はまったく類似していないことを示します。

- 2 つのベクトルの内積を計算します。

- 2 つのベクトルのノルムを計算します。

- 2 つのベクトルの内積を、2 つのベクトルのノルムの積で割ります。

コサイン類似度の利点

コサイン類似度には、いくつかの利点があります。

究極の作業環境構築!新卒エンジニアの生産性UP- スケールに依存しません。コサイン類似度は、ベクトルのスケールに影響されません。これは、異なるスケールを持つデータセットを比較する場合に役立ちます。

- スパースデータに適しています。コサイン類似度は、スパースデータ(多くの要素が 0 であるデータ)に適しています。これは、テキスト文書や画像などのデータセットを比較する場合に役立ちます。

- 計算が簡単です。コサイン類似度は計算が比較的簡単で、多くのプログラミング言語で実装されています。

コサイン類似度の用途

コサイン類似度は、さまざまなアプリケーションで使用されています。

- テキスト文書の類似度検索。コサイン類似度は、テキスト文書の類似度を検索するために使用できます。これは、文書検索エンジンや推薦システムに役立ちます。

- 画像の類似度検索。コサイン類似度は、画像の類似度を検索するために使用できます。これは、画像検索エンジンや画像認識システムに役立ちます。

- ユーザーの類似性評価。コサイン類似度は、ユーザーの類似性評価のために使用できます。これは、推薦システムやターゲティング広告に役立ちます。

コサイン類似度の注意点

コサイン類似度には、いくつかの注意点があります。

- 意味を考慮しません。コサイン類似度は、ベクトルの意味を考慮しません。これは、2 つのベクトルが同じ単語を含んでいても、その意味が異なる場合に問題となる可能性があります。

- データのスパースネスの影響。コサイン類似度は、データのスパースネスの影響を受けます。データがスパースな場合、コサイン類似度は信頼性が低くなる可能性があります。

Bag of Wordsのコサイン類似度とは?

Bag of Wordsのコサイン類似度は、2つの文書の類似度を測るために用いられる手法です。文書を単語の集合として捉え、それぞれの単語の出現回数をベクトルとして表現します。このベクトルの間の角度をコサインで計算し、その値が類似度を表します。

日立製作所 新卒エンジニアのリアル!意外な発見コサイン類似度の計算方法

コサイン類似度は、2つのベクトルの内積を、それぞれのベクトルのノルムの積で割った値です。

ベクトルの内積: 2つのベクトルの対応する要素を掛け合わせて、その合計を計算します。

ベクトルのノルム: ベクトルそれぞれの要素を2乗して合計し、その平方根を求めたものです。

コサイン類似度は、0から1までの値を取り、1に近いほど類似度が高いことを示します。

Bag of Wordsの利点

単純で実装が容易: 文書を単語の集合として表現する手法は、実装が容易です。

単語の順番を考慮しない: 文書内の単語の順番を考慮しないため、文法や意味を無視して、単語の出現頻度のみで類似度を評価できます。

様々な文書に適用可能: テキスト文書だけでなく、コードや画像などの様々な文書に適用できます。

Bag of Wordsの欠点

単語の順番を考慮しない: 文書内の単語の順番を考慮しないため、意味的に異なる文書が類似度が高いと判定される可能性があります。

単語の多義性: 同じ単語が異なる意味を持つ場合、単語の出現頻度のみで類似度を評価すると、誤った結果が得られる可能性があります。

疎なベクトル: 文書中の単語数は膨大であるため、単語の出現頻度をベクトルで表現すると、多くの要素が0になります。

コサイン類似度の応用

文書検索: 検索クエリと文書の類似度を計算し、関連性の高い文書を検索します。

文書分類: 文書の類似度に基づいて、文書を異なるカテゴリに分類します。

文書要約: 複数の文書を統合し、類似度に基づいて重要な情報を抽出します。

Bag of Wordsのコサイン類似度の具体的な例

例えば、以下の2つの文書を考えます。

文書1: "今日は天気が良いですね。"

文書2: "今日は雨が降っています。"

Bag of Wordsで表現すると、それぞれの文書は以下のようなベクトルになります。

文書1: {"今日は":1, "天気":1, "良い":1, "ですね":1, "雨が":0, "降っています":0}

文書2: {"今日は":1, "天気":0, "良い":0, "ですね":0, "雨が":1, "降っています":1}

この2つのベクトルのコサイン類似度を計算すると、0.29となります。これは、2つの文書がそれほど似ていないことを示しています。

単語ベクトル間のcosine類似度とは?

単語ベクトル間のcosine類似度は、2つの単語ベクトルの間の類似度を測定する指標です。これは、2つのベクトル間の角度の余弦を計算することで得られます。角度が小さいほど、2つの単語ベクトルはより類似していることを示します。

なぜcosine類似度を使用するのか?

- 単語ベクトルは通常、高次元空間にあるため、ユークリッド距離は適切な類似度指標ではありません。 ユークリッド距離は、ベクトル間の絶対的な距離を測定しますが、単語ベクトル間の類似度は、ベクトルの間の角度に依存します。

- cosine類似度は、ベクトル長の影響を受けません。 2つの単語ベクトルが同じ方向を向いている場合、それらのcosine類似度は1になります。これは、ベクトルがどれだけ長いかに関わらず、2つのベクトルが同じ意味を持っていることを示します。

cosine類似度の計算方法

- 2つの単語ベクトル、v1 と v2 を取得します。

- v1 と v2 の内積を計算します。

- v1 と v2 のノルムを計算します。

- 内積を v1 と v2 のノルムの積で割ります。

cosine類似度の例

2つの単語ベクトル、"猫"と"犬"があるとします。これらの単語ベクトルは、それぞれ、[0.1, 0.2, 0.3] と [0.2, 0.3, 0.4] です。これらのベクトル間のcosine類似度は、次のようになります。

cos(θ) = (0.1 0.2 + 0.2 0.3 + 0.3 0.4) / (√(0.1² + 0.2² + 0.3²) √(0.2² + 0.3² + 0.4²)) = 0.97

これは、"猫"と"犬"が非常に類似していることを示しています。

cosine類似度の応用

- 文書の類似度検索

- 単語のクラスタリング

- レコメンドシステム

詳細情報

文章間類似度測定方法まとめ:アルゴリズム比較について、基本的な質問は何ですか?

文章間類似度測定方法まとめ:アルゴリズム比較は、異なる文章間の類似度を数値化する様々なアルゴリズムを比較・検討したものです。基本的な質問としては、どのようなアルゴリズムが存在するのか、それぞれのアルゴリズムの強みと弱みは何か、どのアルゴリズムが特定のタスクに適しているのかなどが挙げられます。このまとめでは、これらの質問に対する答えを探求し、具体的なアルゴリズムの特徴や適用例を紹介することで、文章間類似度測定の理解を深めます。

文章間類似度測定でよく用いられるアルゴリズムにはどんなものがありますか?

文章間類似度測定によく用いられるアルゴリズムには、大きく分けてベクトル空間モデル、確率的言語モデル、深層学習モデルの3つのカテゴリーがあります。

ベクトル空間モデルは、文章を単語ベクトルで表現し、ベクトル間の類似度を計算する手法です。コサイン類似度やユークリッド距離などの指標が用いられます。このモデルは、計算が高速で実装が容易なため、多くの場面で使用されています。

確率的言語モデルは、文章を単語の確率分布として表現し、2つの文章の確率分布間の類似度を計算する手法です。ジェンセン・シャノン距離やKLダイバージェンスなどの指標が用いられます。このモデルは、文法や意味の情報を考慮できるため、複雑な文章の類似度を評価する際に有効です。

深層学習モデルは、ニューラルネットワークを用いて文章を表現し、その表現間の類似度を計算する手法です。BERTやGPTなどの事前学習済み言語モデルが用いられます。このモデルは、他のモデルに比べて高精度な類似度評価が可能ですが、計算コストが高く、学習データの量も必要となります。

どのアルゴリズムが自分のタスクに適しているのか、どうやって判断すればいいですか?

どのアルゴリズムが自分のタスクに適しているかを判断するには、以下の点を考慮する必要があります。

タスクの目的: 単純な類似度評価なのか、特定の文法・意味情報を考慮した評価なのか

データの特徴: 文章の長さ、単語の頻度、専門用語の有無など

計算資源: 計算時間、メモリ容量など

精度: 必要な精度レベル

例えば、単純な類似度評価であればベクトル空間モデルが適していますが、文法・意味情報を考慮する必要がある場合は確率的言語モデルや深層学習モデルの方が適しています。また、データが大量で計算資源に余裕がある場合は深層学習モデルが有効ですが、計算資源が限られている場合はベクトル空間モデルや確率的言語モデルの方が現実的です。

文章間類似度測定はどのような場面で役立ちますか?

文章間類似度測定は、様々な場面で役立ちます。

文書検索: 検索クエリと文書の類似度に基づいて、関連性の高い文書を検索する

文書分類: 文書の内容に基づいて、適切なカテゴリーに分類する

自動要約: 長い文章を要約する際に、類似度の高い文を選択する

機械翻訳: 翻訳の質を評価する

対話システム: ユーザーの発言と過去の会話内容の類似度に基づいて、適切な応答を生成する

このように、文章間類似度測定は、自然言語処理において重要な役割を果たしています。

文章間類似度測定方法まとめ:アルゴリズム比較 に類似した他の記事を知りたい場合は、Gijutsu カテゴリにアクセスしてください。

関連記事